+

+

+

+

+

+  +

+

+

+

+

+  +

+

+

+

+

+

+

+

+### 手动安装:

+

+### [创建一个虚拟环境](https://github.com/34j/so-vits-svc-fork/wiki#creating-a-virtual-environment)

+

+### 安装

+

+通过 pip 安装 (或者通过包管理器使用 pip 安装):

```shell

-# contentvec

-http://obs.cstcloud.cn/share/obs/sankagenkeshi/checkpoint_best_legacy_500.pt

-# 也可手动下载放在hubert目录

+python -m pip install -U pip setuptools wheel

+pip install -U torch torchaudio --index-url https://download.pytorch.org/whl/cu117

+pip install -U so-vits-svc-fork

```

-#### **可选项(强烈建议使用)**

-

-- 预训练底模文件: `G_0.pth` `D_0.pth`

- - 放在`logs/44k`目录下

-

-从 svc-develop-team(待定)或任何其他地方获取

-

-虽然底模一般不会引起什么版权问题,但还是请注意一下,比如事先询问作者,又或者作者在模型描述中明确写明了可行的用途

+- 如果没有可用 GPU, 不需要执行 `pip install -U torch torchaudio --index-url https://download.pytorch.org/whl/cu117`.

+- 如果在 Linux 下使用 AMD GPU, 请使用此命令 `--index-url https://download.pytorch.org/whl/rocm5.4.2`

+ 替换掉 `--index-url https://download.pytorch.org/whl/cu117` . Windows 下不支持 AMD GPUs (#120).

+- 如果 `fairseq` 报错:

+ - 如果提示 [`Microsoft C++ Build Tools`](https://visualstudio.microsoft.com/visual-cpp-build-tools/) 没有安装. 安装即可.

+ - 如果提示缺少 dll 文件, 重新安装 `Microsoft Visual C++ 2022` 和 `Windows SDK` 可能有用

-## 数据集准备

+### 更新

-仅需要以以下文件结构将数据集放入 dataset_raw 目录即可

+请经常更新以获取最新功能和修复错误:

```shell

-dataset_raw

-├───speaker0

-│ ├───xxx1-xxx1.wav

-│ ├───...

-│ └───Lxx-0xx8.wav

-└───speaker1

- ├───xx2-0xxx2.wav

- ├───...

- └───xxx7-xxx007.wav

+pip install -U so-vits-svc-fork

```

-## 数据预处理

+## 使用教程

-1. 重采样至 44100hz

+### 推理

-```shell

-python resample.py

-```

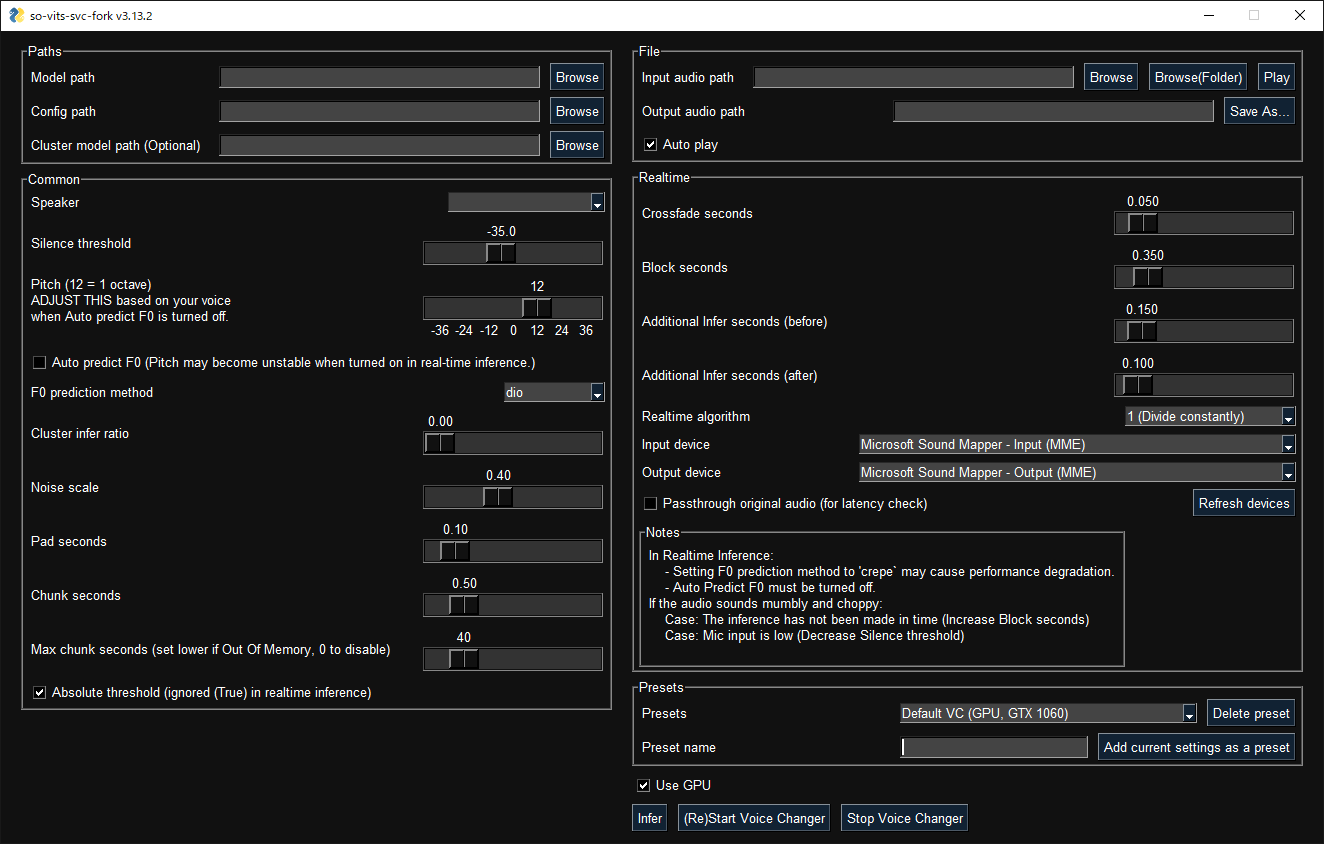

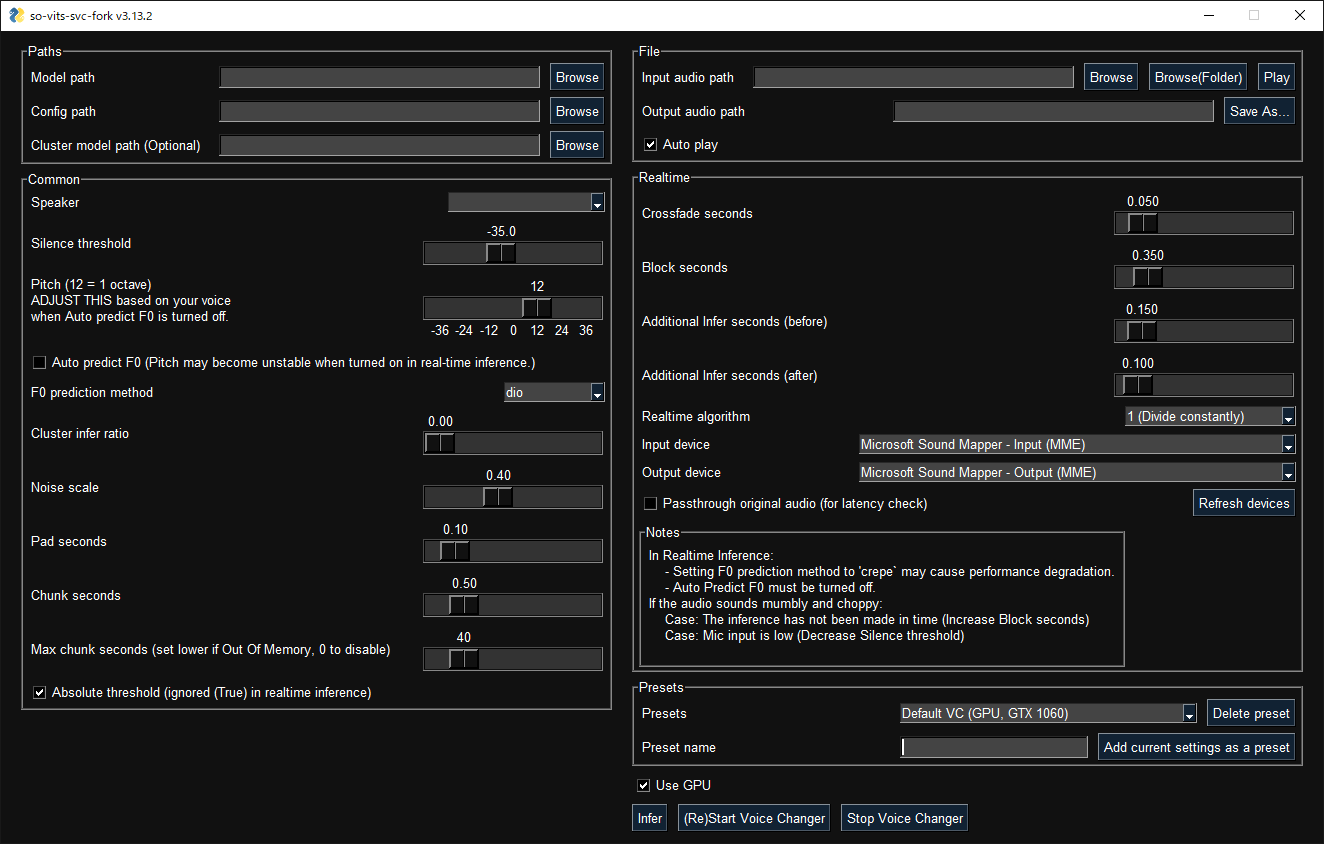

+#### 图形化界面

-2. 自动划分训练集 验证集 测试集 以及自动生成配置文件

+

-```shell

-python preprocess_flist_config.py

-```

-

-3. 生成 hubert 与 f0

+请使用以下命令运行图形化界面:

```shell

-python preprocess_hubert_f0.py

+svcg

```

-执行完以上步骤后 dataset 目录便是预处理完成的数据,可以删除 dataset_raw 文件夹了

+#### 命令行界面

-## 训练

+- 实时转换 (输入源为麦克风)

```shell

-python train.py -c configs/config.json -m 44k

+svc vc --model-path

+

+

+### 手动安装:

+

+### [创建一个虚拟环境](https://github.com/34j/so-vits-svc-fork/wiki#creating-a-virtual-environment)

+

+### 安装

+

+通过 pip 安装 (或者通过包管理器使用 pip 安装):

```shell

-# contentvec

-http://obs.cstcloud.cn/share/obs/sankagenkeshi/checkpoint_best_legacy_500.pt

-# 也可手动下载放在hubert目录

+python -m pip install -U pip setuptools wheel

+pip install -U torch torchaudio --index-url https://download.pytorch.org/whl/cu117

+pip install -U so-vits-svc-fork

```

-#### **可选项(强烈建议使用)**

-

-- 预训练底模文件: `G_0.pth` `D_0.pth`

- - 放在`logs/44k`目录下

-

-从 svc-develop-team(待定)或任何其他地方获取

-

-虽然底模一般不会引起什么版权问题,但还是请注意一下,比如事先询问作者,又或者作者在模型描述中明确写明了可行的用途

+- 如果没有可用 GPU, 不需要执行 `pip install -U torch torchaudio --index-url https://download.pytorch.org/whl/cu117`.

+- 如果在 Linux 下使用 AMD GPU, 请使用此命令 `--index-url https://download.pytorch.org/whl/rocm5.4.2`

+ 替换掉 `--index-url https://download.pytorch.org/whl/cu117` . Windows 下不支持 AMD GPUs (#120).

+- 如果 `fairseq` 报错:

+ - 如果提示 [`Microsoft C++ Build Tools`](https://visualstudio.microsoft.com/visual-cpp-build-tools/) 没有安装. 安装即可.

+ - 如果提示缺少 dll 文件, 重新安装 `Microsoft Visual C++ 2022` 和 `Windows SDK` 可能有用

-## 数据集准备

+### 更新

-仅需要以以下文件结构将数据集放入 dataset_raw 目录即可

+请经常更新以获取最新功能和修复错误:

```shell

-dataset_raw

-├───speaker0

-│ ├───xxx1-xxx1.wav

-│ ├───...

-│ └───Lxx-0xx8.wav

-└───speaker1

- ├───xx2-0xxx2.wav

- ├───...

- └───xxx7-xxx007.wav

+pip install -U so-vits-svc-fork

```

-## 数据预处理

+## 使用教程

-1. 重采样至 44100hz

+### 推理

-```shell

-python resample.py

-```

+#### 图形化界面

-2. 自动划分训练集 验证集 测试集 以及自动生成配置文件

+

-```shell

-python preprocess_flist_config.py

-```

-

-3. 生成 hubert 与 f0

+请使用以下命令运行图形化界面:

```shell

-python preprocess_hubert_f0.py

+svcg

```

-执行完以上步骤后 dataset 目录便是预处理完成的数据,可以删除 dataset_raw 文件夹了

+#### 命令行界面

-## 训练

+- 实时转换 (输入源为麦克风)

```shell

-python train.py -c configs/config.json -m 44k

+svc vc --model-path 34j 💻 🤔 📖 💡 🚇 🚧 👀 ⚠️ ✅ 📣 🐛 |

+ GarrettConway 💻 🐛 📖 |

+ BlueAmulet 🤔 💬 💻 |

+ ThrowawayAccount01 🐛 |

+ 緋 📖 🐛 |

+ Lordmau5 🐛 💻 |

+ DL909 🐛 |

+

Satisfy256 🐛 |

+ Pierluigi Zagaria 📓 |

+ ruckusmattster 🐛 |

+ Desuka-art 🐛 |

+ heyfixit 📖 |

+ Nerdy Rodent 📹 |

+