-

Notifications

You must be signed in to change notification settings - Fork 41

New issue

Have a question about this project? Sign up for a free GitHub account to open an issue and contact its maintainers and the community.

By clicking “Sign up for GitHub”, you agree to our terms of service and privacy statement. We’ll occasionally send you account related emails.

Already on GitHub? Sign in to your account

[20220213] Weekly AI ArXiv 만담 - 39회차 #39

Comments

|

심층 강화 학습으로 챔피언 Gran Turismo 드라이버에게 승리

[단독인터뷰] 팀닛 게브루 박사가 한국에 던진 질문 "한국 빅테크 기업 개발자는 자신의 소신을 밝힐 수 있는가"

데이터 기본법 시행, 4월20일

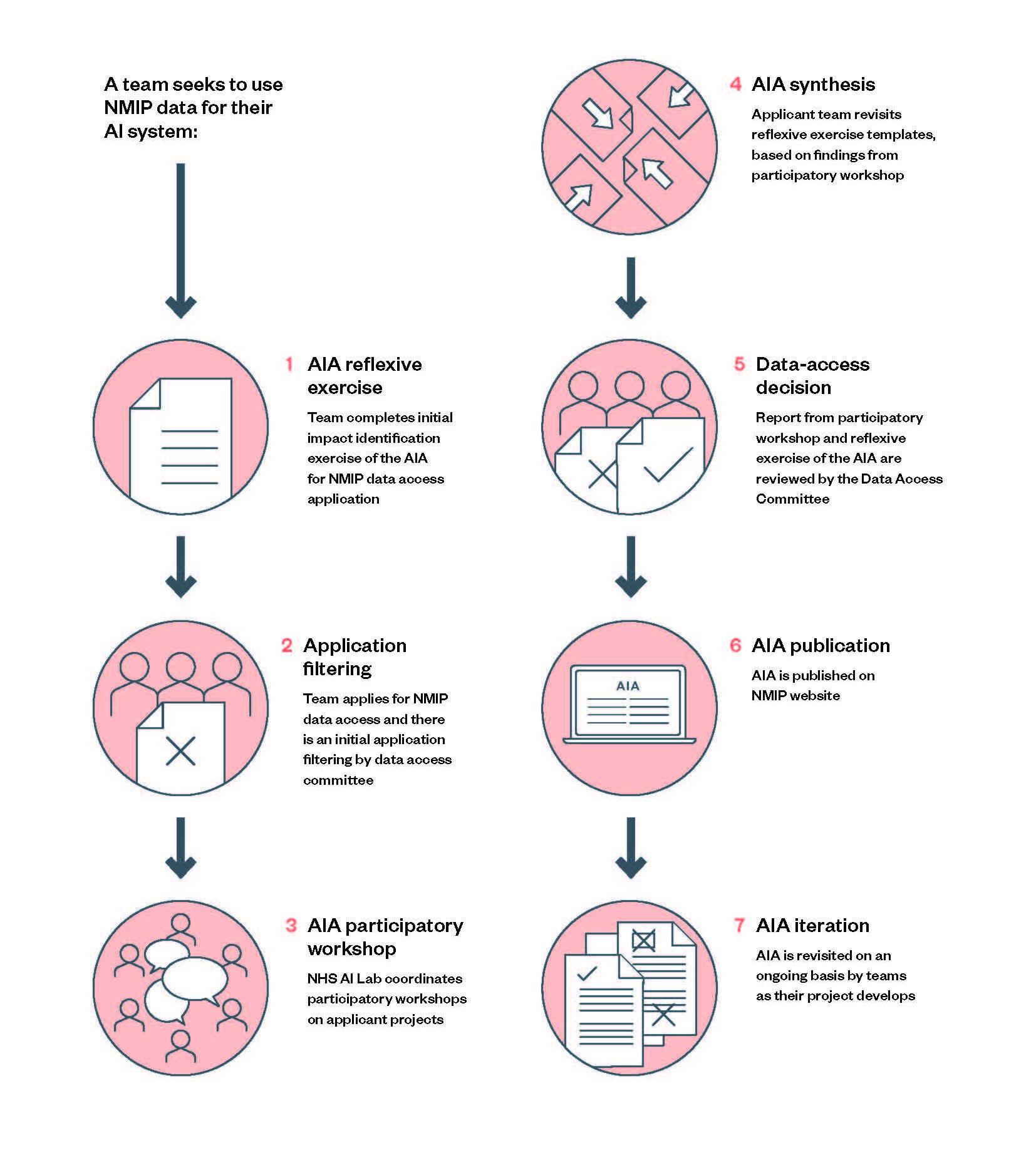

영국 NHS, 의료 인공지능에 대한 알고리즘 영향 평가(AIAs: algorithmic impact assessments) 파일럿 시행

|

|

MuZero with Self-competition for Rate Control in VP9 Video Compression 딥마인드에서 기존 체스, 바둑, 등 여러 게임을 규칙을 제공받지 않고 스스로 학습한 MuZero 모델을 video compression task에 적용하여 4~6% 가량 추가 압축을 구현했다고 합니다. 인터넷의 상당 부분이 비디오 전송인 것을 고려할 때 매우 중요한 연구로 생각됩니다. 다만, 강화학습 모델을 적용할 때 추가 연산이 가성비가 나올지 의문입니다. Blog: https://deepmind.com/blog/article/MuZeros-first-step-from-research-into-the-real-world Arxiv: https://storage.googleapis.com/deepmind-media/MuZero/MuZero%20with%20self-competition.pdf Computer Vision: Algorithms and Applications 2nd ed. 2022 Edition 출간 컴퓨터 비전 분야의 대표 교과서인 Szleski Computer Vision의 신간판이 출시되었습니다. Classical computer vision에 대한 심도 있는 이해뿐만 아니라 최신 딥러닝을 적용한 내용 또한 대폭 추가되었습니다. Website: https://szeliski.org/Book PDF 제공 링크: https://szeliski.org/Book/download.php AI in health and medicine Nature Medicine에서 의료 분야에 인공지능을 적용하는 것에 대한 리뷰 논문이 나왔습니다. 매우 새로운 내용은 없지만 citation들을 찾아보면 최근 트렌드를 파악하기 좋을 것 같습니다. https://www.nature.com/articles/s41591-021-01614-0 When Shift Operation Meets Vision Transformer: An Extremely Simple Alternative to Attention Mechanism Microsoft Research Asia(MRSA)에서 Self-Attention 대신 shift operator를 적용했을 때에도 self-attention과 유사한 성능을 보일 수 있는 내용의 논문을 냈습니다. 최근 초거대 인공지능의 부담이 self-attention으로 인한 것임을 감안할 때 매우 중요한 연구로 생각됩니다. GitHub: https://github.com/microsoft/SPACH Arxiv: https://arxiv.org/abs/2201.10801 특히 Swin Transformer의 구조를 도입했을 때 parameter의 숫자가 같아지도록 더 깊은 모델을 학습했을 때 Swin Transformer 이상의 성능을 보였다고 주장하는데 이는 유의미한 결과라고 봅니다. |

|

Einops: Clear and Reliable Tensor Manipulations with Einstein-like Notation ICLR 2022 Oral Session에 EinOps 논문이 Oral Session으로 채택되어 상당한 논란이 있었습니다. 특히 Transformer 분야에서 많이 사용하는 notation 이고 의의는 있었으나 ICLR의 존재 의의 및 역할이 무엇인지 고민을 하게 되는 것 같습니다. OpenReview: https://openreview.net/forum?id=oapKSVM2bcj |

|

|

Learning robust perceptive locomotion for quadrupedal robots in the wild (Science Robotics)

|

Block-NeRF: Scalable Large Scene Neural View Synthesis

MaskGIT: Masked Generative Image Transformer

Scaling Law for Recommendation Models: Towards General-purpose User Representations

기타 눈에 띄는 논문

The text was updated successfully, but these errors were encountered: