-

Notifications

You must be signed in to change notification settings - Fork 41

New issue

Have a question about this project? Sign up for a free GitHub account to open an issue and contact its maintainers and the community.

By clicking “Sign up for GitHub”, you agree to our terms of service and privacy statement. We’ll occasionally send you account related emails.

Already on GitHub? Sign in to your account

[20220529] Weekly AI ArXiv 만담 - 53회차 #53

Comments

Arxiv

|

인공지능이 무기 된 시대, 중점 육성할 3가지 AI 기술은

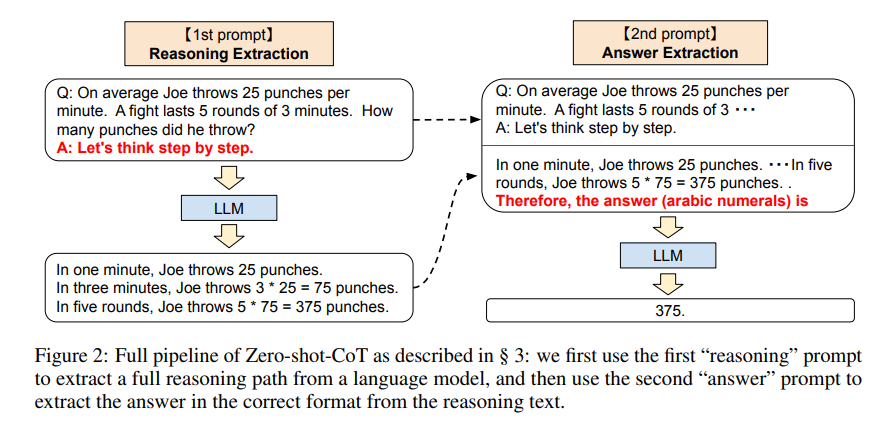

Large Language Models are Zero-Shot Reasoners - 신비로운 LLM

Autoformalization with Large Language Models

Google blog - Language Models Perform Reasoning via Chain of Thought

|

Sign up for free

to join this conversation on GitHub.

Already have an account?

Sign in to comment

Photorealistic Text-to-Image Diffusion Models with Deep Language Understanding

AdaptFormer: Adapting Vision Transformers for Scalable Visual Recognition

흥미있는 연구

The text was updated successfully, but these errors were encountered: