-

Notifications

You must be signed in to change notification settings - Fork 41

New issue

Have a question about this project? Sign up for a free GitHub account to open an issue and contact its maintainers and the community.

By clicking “Sign up for GitHub”, you agree to our terms of service and privacy statement. We’ll occasionally send you account related emails.

Already on GitHub? Sign in to your account

[20220626] Weekly AI ArXiv 만담 - 56회차 #56

Comments

Github Copilot 유료화 포함한 공식 서비스 시작https://github.com/github-copilot/signup

Amazon launches CodeWhisperer, a GitHub Copilot-like AI pair programming toolhttps://techcrunch.com/2022/06/23/amazon-launches-codewhisperer-its-ai-pair-programming-tool/

캐나다, 인공지능 시스템 규제 법안 발의https://www.lexology.com/library/detail.aspx?g=399217a6-ff76-4bfc-bf90-4d11a1d96dbf

ISO/IEC AI Workshop sessions (5/24 ~ 5/25)

|

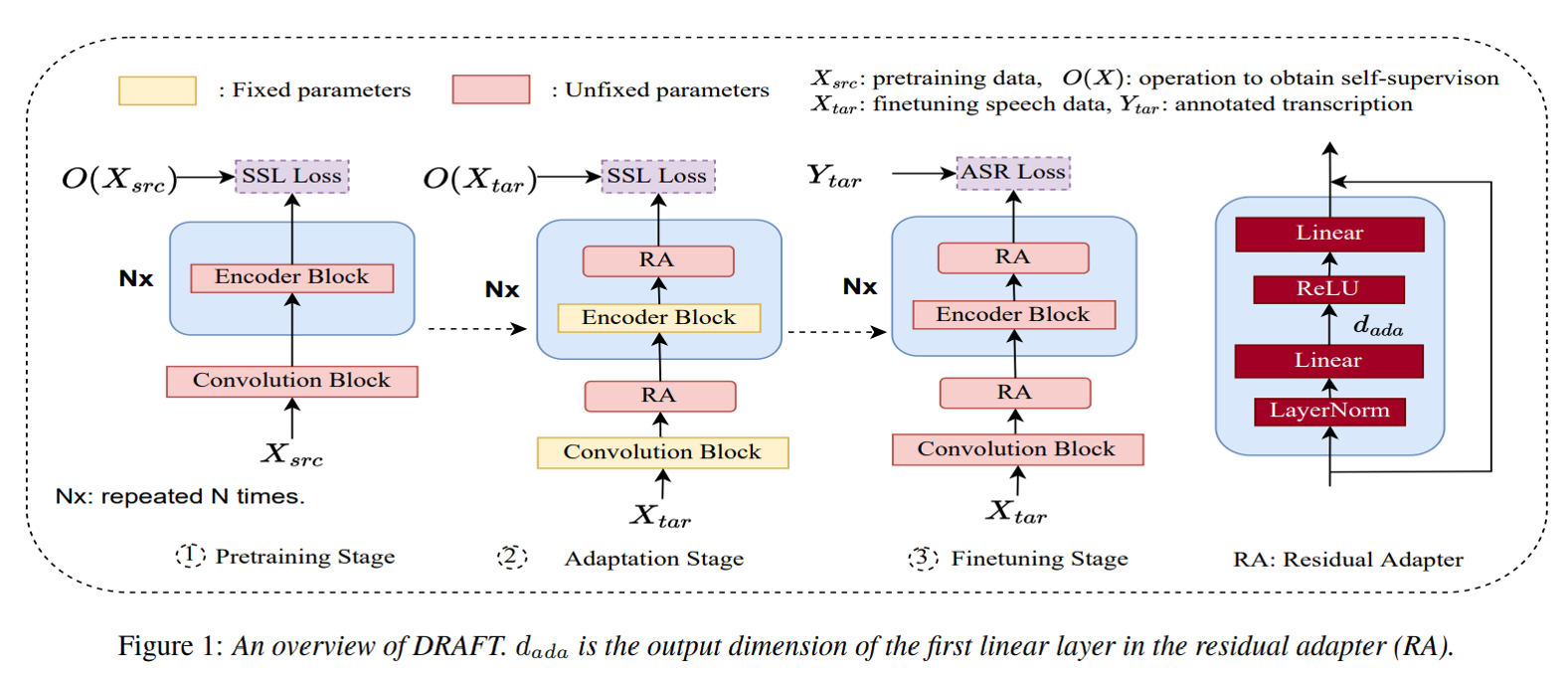

Arxiv (Audio and Speech Processing)

|

|

|

Tracing with Primitives: TorchDynamo & nvFuser PyTorch 라이브러리의 미래 진행 방향이 Julia와 매우 유사한 방향으로 진행되는 것으로 PyTorch Dev Blog에 공지되었습니다. 지금까지 딥러닝 라이브러리의 주요 패러다임은 low-level CUDA C/C++로 핵심 코드를 작성하고 Python으로 high-level wrapper를 작성하는 방식으로만 진행이 되어오되 eager execution을 통해 사용자 편의성을 중시해오고 최적화를 위해서는 flexibility를 희생시킨 graph mode를 사용해서 JIT Compile을 진행해야만 했습니다. 하지만 현재 방식은 새로운 operation을 정의할 때마다 low-level kernel을 작성해야해서 현재 PyTorch에는 2,000개가 넘는 operator가 있다고 합니다. 이런 문제점을 해결하기 위해 primitive operation을 정의하고 Python에서 interpreter가 bytecode를 받는 단계에서 bytecode를 수정함으로써 symbolic kernel fusion을 실현하는 방향으로 나아갈 것이라고 합니다. 이런 방법의 장점은 추후 high-level에서 Python으로 새로운 프로그램을 작성하더라도 여러 hardware accelerator에서 최적화된 kernel이 실행된다는 점입니다. 이미 90% 이상의 repository에서 accuracy가 100%인 것을 발표했는데 추후 연구개발을 진행하는데 많은 도움이 될 것 같습니다. PyTorch Dev Blog에 관련 여러 포스트가 있는데 아래 정리해드립니다. TorchDynamo GitHub: https://github.com/pytorch/torchdynamo Where PyTorch is Headed: https://dev-discuss.pytorch.org/t/where-we-are-headed-and-why-it-looks-a-lot-like-julia-but-not-exactly-like-julia/276 DeepMind Educational Resources GitHub: https://github.com/deepmind/educational 딥마인드에서 머신러닝 및 딥러닝을 설명하기 위한 Colab이 오픈소스되었습니다. 비전문가에게 딥러닝을 설명하실 때 많은 도움이 될 것 같습니다. OmniXAI GitHub: https://github.com/salesforce/OmniXAI Salesforce에서 설명가능한 인공지능을 위한 OmniXAI 라이브러리를 공개했습니다. PyTorch의 Captum과 함께 연구자들에게 많은 도움이 될 것 같습니다. Lightning Transformers PyTorch Lightning과 HuggingFace Transformers를 같이 사용할 수 있는 새로운 repository가 공개되었습니다. NLP 분야에서 많은 도움이 될 것 같습니다. GitHub: https://github.com/Lightning-AI/lightning-transformers Unified-IO: A Unified Model for Vision, Language, and Multi-Modal Tasks Allen Institute for AI 에서 Unified IO라는 vision/language general-purpose model을 공개했습니다. Arxiv: https://arxiv.org/abs/2206.08916 |

|

<홍보 한가지 하겠습니다 :) > 안녕하세요. PR12에서 5기 멤버를 추가로 6명 모집합니다 작년 3월 7일 첫 발표를 시작한 PR12 Season 4가 어느덧 100편의 논문 리뷰를 앞드고 있습니다(현재 392편 리뷰 완료) PR12를 함께하시면 함께하시는 훌륭하신 리뷰어 분들과 네트워킹도 할 수 있고

정말 딥러닝 초 고수가 될수 있는 PR12에 많은 관심 부탁드립니다. <PR12 다시보기> |

News

ArXiv

Scaling Autoregressive Models for Content-Rich Text-to-Image Generation

Rarity Score : A New Metric to Evaluate the Uncommonness of Synthesized Images

흥미있는 연구

The text was updated successfully, but these errors were encountered: