随着图像编辑技术的迭代,高水平的篡改图像往往伴随着精细的边缘平滑与复杂的后处理,这对现有的取证模型构成了严峻挑战。主流方法在利用 Vision Transformer 捕获长程语义依赖时,往往因分块而丢失高频边缘信息和篡改痕迹;而传统的噪声流网络虽能提取局部异常,却易受图像固有纹理干扰产生大量误报。针对上述问题,本文提出了一种基于频域分析与语义引导的两阶段图像篡改定位框架。 首先,我们构建了基于 DINOv3 的语义分支以提取鲁棒的全局一致性特征,同时采用 DCT-II 变换模拟 JPEG 块级压缩,实现了物理压缩指纹与图像内容的解耦。 其次,为解决多模态融合中的特征不对齐问题,我们提出了一种轻量级的空间-语义门控机制,该机制抑制噪声突出篡改痕迹,且相比CBP显著降低计算复杂度。 最后,我们采用由粗到细的两阶段定位策略,结合 UperNet 的多尺度解码,在显式的边界损失约束下消除预测掩码的模糊效应。 在 CASIA、Columbia 及 IMD2020 数据集上的广泛实验表明,该模型在保持推理高效的同时,显著提升了在强压缩及复杂后处理场景下的定位精度,F1 分数在CASIAv1上达到了0.7387。

如今, 多媒体编辑工具越发成熟, 不断进步的图像处理技术和图像编辑工具高度融入我们的生活,修改图像的成本越来越低,篡改图像的质量越来越高。诚然,这为我们的生活带来了便利,但也不可避免地带来了安全问题。高质量的篡改图像难以通过肉眼识别,其通过互联网的传播将造成虚假信息传播、舆情干扰等重大事故。

基于这些问题,数字媒体取证领域迅速崛起。数字媒体取证是数字取证的一个重要分支,主要针对图像、音频、视频等多媒体数据的真实性、完整性和来源进行分析与验证。它旨在识别数字媒体是否被篡改、伪造或合成,并提供可用于司法、舆情管理和网络安全的可靠证据。而图像取证是数字媒体取证的一个重要分支。

目前图像篡改可进行如下分类。按照篡改主体,我们将其分为自然图像篡改和人脸篡改两类。而对于自然图像篡改,主要包括复制粘贴(Copy-move), 拼接(Splicing), 移除(removing)三种类型。拼接将来源于宿主图像之外的内容移接到宿主图像中的某个区域,如果操作得当拼接区域间的边缘视觉上不可鉴别【Image Forgery Detection】【基于深度学习的数字图像篡改定位方法综述】;复制移动首先复制图像中的某些区域(源区域),并将它们移动覆盖到其他区域(目标区域);移除是指擦除图像中的某个物体,并填充其语义相匹配的内容。在实际应用中,这三类篡改通常配合出现以保证篡改图像的逼真性。同时为了进一步削弱篡改痕迹,这些图像会经过缩放、亮度调整、边界平滑和滤波等处理操作,并且在保存的时候经过有损压缩。尽管这些篡改难以鉴别,但它们都会留下相应的痕迹。

检测复制粘贴的核心在于寻找相同性。【Detection of Copy-Move Forgery in Digital Images】首先应用块离散余弦变换(DCT)。其将图像切割成许多重叠的小块,对每一块进行离散余弦变换(DCT),提取其频率系数作为特征向量,最后利用词典排序对特征向量进行排序。其虽然有效,但DCT提取的特征向量维度较高,计算复杂度高,于是【Popescu and Farid (2004), "Exposing Digital Forgeries by Detecting Duplicated Image Regions"】运用主成分分析(PCA)对图像块进行降维,提取主要特征值的同时丢弃微小噪声干扰,但以上两种方法都存在鲁棒性差的问题,图像进行旋转和缩放后DCT系数就会完全改变,导致检测失败。【Huang et al. (2008), "Detection of Copy-Move Forgery in Digital Images Using SIFT Algorithm"】通过在图像中寻找具有尺寸不变性的关键点并生成描述符记录周围梯度的方向分布,然后寻找描述符距离最小的点对,并确认点对之间是否存在一致的图像变换关系。但是SIFT依赖于纹理,在图像的平滑区域无法提取到足够的特征点,导致漏检。DCT在平滑区域检测效果优于SIFT。

检测拼接的核心在于寻找不一致性。【Ng et al. (2004), "A Data Set and Statistics for Digital Image Splicing"。】表明拼接图像在拼接边缘会引入不自然的非线性特征,所以可以利用高阶统计量(双铺/双相干)来捕获信号的非线性。但如果对图像进行轻微的模糊处理或者重新保存,这些统计上的微小不一致性就会被抹除。【Chen et al. (2008), "Determining Image Forgery Using Sensor Pattern Noise"。】提出每个相机传感器都有独特的指纹,可以通过去噪滤波器提取图像的光响应性非均匀性(PRNU)噪声计算图像不同区域间的指纹相关性,从而判别是否存在局部区域指纹不一致的线性。但这种方法对图像质量要求极高,且在低光照、强压缩或小面积拼接的情况下,PRNU信号太弱无法可靠提取。【Popescu and Farid (2004), "Statistical Tools for Detecting Copy-Move Forgery"】提出被拼接的区域通常来自一张已经过JPEG压缩的图,粘贴到新图后再保存,该区域经历了两次压缩,而背景只有一次。所以可以利用DCT系数直方图分析双重JPEG压缩的不同特性,从而锁定拼接位置。

消除类似于复制粘贴和拼接的结合。它从图像的背景区域搜索相似的纹理块来填充被删除的空洞,其填充数据从内部数据采样,具有复制粘贴的特性;填充过程实际上是一中内部拼接,具有拼接的边缘特性。但同时,消除进一步通过纹理合成的后处理使得边缘平滑和纹理匹配,让其更难检测。【Wu et al. (2008), "Exposing Digital Forgeries by Detecting Inpainted Image Regions"。】通过纹理合成的过于完美的线性关系,利用零自相关或像素差分统计检查图像中是否存在不寻常的预测残差来定位被修补的区域。但这种方法仅能检测非常原始的插值填充,对于现代复杂的纹理合成误报率极高。【Zhang et al. (2010), "Detecting Image Inpainting Forgery with Local Texture Descriptors"。】发现无论填充算法多么高明,在原物体边缘于填充区域的交界处,通常会留下细微的模糊或纹理方向的断层。其利用局部三值模式(LTP)或改进的局部二值模式(LBP)特征计算图像块的频率分布,寻找那些异常平滑或纹理重复度过高的闭合区域。但如果篡改这在消除物体后对全图进行了统一的加噪或锐化,这些边缘特征就会被掩盖。【Chen et al. (2013), "Exposing Region-filling Forgery Using Micro-statistic Features"。】考虑相机传感器的热噪声,使用高通滤波器计算噪声的局部一致性。但对于分辨率低的图像效果不好。

综上所述,传统的方法虽然在物理特性上解释性很强,但都对于后处理攻击下鲁棒性极差。当图像经过多重JPEG压缩、重采样、加噪或者复杂的非线性编辑后,传统的手工特征往往会迅速失效。并且传统机器学习通常是块级别(e.g. DCT)或者点级别(e.g. SIFT)的定位,精度较差,导致边缘部分锯齿严重或完全缺失,内部容易产生漏检出现空洞。同时,传统机器学习对于不同类的篡改方法不同,而通常一张图像中具有多种篡改类型,使用以上方法将显著增加复杂性。

随着卷积神经网络(CNN)在计算机视觉领域的爆发,研究者们意识到神经网络强大的特征提取能力可以完美弥补传统算法在复杂后处理下的脆弱性,并且CNN以像素为单位输入,定位精准。

传统的CNN旨在提取语义信息,会自动滤除高频噪声。但在篡改定位中,图像的低频语义信息反而是干扰,篡改留下高频细微残差才是关键。【Bayar and Stamm (2016), "A Deep Learning Approach to Data-Hiding Genealogies】提出约束卷积(Constrained Convolution),使卷积核中心权重为-1,且其余权重之和为1,所有权重之和相加为0。这本质上实在网络底层强制学习一个自适应的高通滤波器,将图像内容抹去,仅提取像素间的非线性预测残差。这种方法成功让模型学习到篡改痕迹而非图像语义信息。但是这种方法只能用于分类判断图像是否被篡改,无法精确定位篡改区域,并且只提取了单种特征,鲁棒性差。例如对低分辨率图像和JPEG压缩图像效果差。

【Zhou et al. (2018), "Learning Rich Features for Image Manipulation Detection" (RGB-N)。】发现图像篡改,尤其是拼接,会同时留下边缘伪影和底层噪声不一致两种痕迹,故提出了双流网络结构。其中RGB流负责提取图像表面的语义特征和视觉伪影,噪声流通过SRM算子提取噪声残差,捕捉传感器指纹的异常。最后通过双线性池化(BP)将两路特征融合,实现内容和噪声的空间共现关系。也就是说,RGB-N在首次一定程度上实现了语义信息和统计信息的融合。相比R-CNN,RGB-N显著提升了鲁棒性。但由于BP计算复杂度极高,导致显存占用高且推理速度慢。并且该模型输出的仅为边界框而不是像素级的掩码。

【“Segmentation-Based Image Forgery Detection and Localization” (Wu et al., 2019 CVPR)(ManTra-Net)】解决了定位粗糙的问题,实现了像素级掩码。并且同时希望建立起一个通用模型,无需针对三类篡改类型单独设计,而是通过寻找异常区域来定位一切篡改。其利用提取器获取256维的局部统计特征,并通过卷积长短期记忆网络(ConvLSTM)在全图空间上进行扫描建立长期依赖,通过局部特征全局特征均值的标准化差异(Z-score)判断图像图像中哪一部分的统计特征于整体环境有显著差别,最终通过全卷积网络输出像素级的Mask。这种方法在一定程度上改善了CNN感受野有限的缺点。它不需要任何预处理或后处理即可输出像素级掩码的全卷积网络,并且对不同的篡改类型具有通用性。但其计算开销极大,训练和推理成本极高,并且假阳性高,容易将强纹理区域误判为篡改。

【“Multi-view Multi-scale Supervision Network for Image Forgery Detection” (Chen et al., 2021 ICCV)(MVSS-NET)】意识到,仅靠噪声指纹容易产生强纹理误报,所以沿用了RGB-N的思想,融合了语义视图和噪声视图。并且相比于ManTra-Net,不仅仅使用像素级的监督,更添加了边缘级监督用于显式训练网络寻找篡改区域的边界,强迫模型去学习物体与背景之间的交界,减少掩码的模糊和粘连。同时添加了图像级监督判断全图是否有篡改,避免在完全干净的图像上产生碎片化的误报。同时其舍弃了ManTra-Net使用的LSTM,而是使用多尺度特征提取器(FCN)和注意力机制,通过集成不同尺寸的特征来捕获大到物体,小到像素邻域的篡改痕迹。这使得MVSS-Net计算复杂度大幅下降,训练和推理速度大幅提升。

传统的CNN由于感受野有限,往往只能捕捉局部痕迹。加入LSTM的方法也会导致计算成本过高。尽管 MVSS-Net 通过多尺度特征提取和空洞卷积在 CNN 框架下极大地扩张了感受野,并利用边缘监督实现了更精准的边界勾勒,但其本质上依然受到卷积运算局部性的限制。此时不同于CNN循序渐进得扩大视野,数字图像取证领域引入了Vision Transformer(ViT),其通过自注意力机制,在首层就实现了全图像素的通信,这使得它不仅能识别细微的边缘伪影,更擅长捕获物体间光影逻辑、材质感等长程语义不一致性。TransForensics【TransForensics: Image Forgery Localization with Dense Self-Attention (ICCV 2021)】使用密集自注意力编码器,通过全局建模来捕获图像块之间的相互作用,并且引入密集修正模块,利用早期层的特征对最终的预测掩码进行多尺度修正。

但是ViT在处理低分辨率或者经过强压缩的图像时,往往会有因分块(patch)导致高频细节丢失的情况。这导致了预测掩码的边缘模糊,难以捕捉微小篡改等精细部分。与此同时,压缩与重采样等物理过程产生的频域指纹在强压缩场景下更稳定,却难以被纯语义网络显示利用。为此,我们寻求一种既能保留 Transformer 全局视野,又能精准还原像素级物理痕迹的稳健架构。ObjectFormer【ObjectFormer for Image Manipulation Detection and Localization (CVPR 2022)】发现现在的篡改手段在RGB域很难有肉眼可见的破绽,需要从频域空间和语义空间两个维度切入。其先利用DCT将图像转到频域,提取高频噪声特征并于RGB特征简单拼接。然后提出物体查询(Object Queries):先通过交叉注意力再图像中锁定并提取图像的特征,此时我们生成了注意力权重图。再通过自注意力对比各物体间的特征,找出篡改物体。最后我们通过这个注意力权重图定位像素,再通过层次化上采样得到篡改区域掩码。在层次化上采样中,我们通过跳跃连接,融合来自编码器早期高分辨率的特征用于修正边界,解决预测掩码的模糊问题。

综上所述,目前的图像篡改模型主要面临两个挑战。(1)如何提取篡改敏感的RGB特征和噪声特征,并实现提取时特征解耦,和高效的特征融合。(2)如何克服ViT由于分块导致局部几何细节丢失,在不造成图像内部空洞的情况下消除掩码边缘模糊,实现像素级精准定位。

对此,我们提出了【】,其核心贡献如下

(1)特征解耦的局部频率分析模块: 针对强压缩环境下篡改痕迹易丢失的问题,我们设计并实现了一个基于 DCT-II 变换的局部频率分析模块。该模块模拟 JPEG 8x8 块级量化过程,能够精准捕获双重压缩产生的统计指纹异常。与传统的单流网络相比,该模块显式地解耦了图像内容与物理背景指纹。

(2)基于空间-语义门控的跨模态特征融合机制: 我们提出了一种轻量化且高效的空间-语义门控融合机制。该机制通过学习可学习的模态权重,动态调节 RGB 语义特征与 DCT 频域特征的贡献度。相比于计算开销巨大的双线性池化(CBP),该方案在显著降低计算延迟的同时,实现了内容和噪声在空间维度上的深度互补,提升了对隐蔽篡改的识别率。

(3)定位-修正两阶段协同约束策略:我们 借鉴了 UPerNet【】 的层级融合思想,利用 DINOv3 的深层语义特征生成捕捉全局不一致性的粗掩码实现初步定位,并配合跳跃连接将浅层提取物理指纹向上注入,从而对边缘进行精化,生成高精度的细掩码。在监督机制上,我们利用 coarse_loss 进行‘面启发’式监督,确保篡改区域的整体连贯性与完整性;同时引入显式的 boundary_loss 进行‘点启发’式额外监督,通过对边缘异常像素的强力约束,纠正了 Transformer 固有的分块模糊效应。

本文的任务是对篡改图像的篡改区域定位。我们采用的模型结构如图1所示。该简单架构包含三个核心组件:(1)冻结的DINOv3主干网络。其用于提取鲁棒的语义特征。(2)局部DCT频域分析模块。用于捕获压缩伪影和频域操纵痕迹。(3)空间-语义门控机制。用于自适应融合语义和频域特征。与传统方法相比,本模型抛去了复杂的纹理分析、多尺度边缘检测和双线性池化等模块,仅通过简洁高效的双分支设计即可达到优异性能。

输入图像首先送入预训练的DINOv3【simeoni2025dinov3】主干网路进行特征提取。我们使用DINOv3-base,其在LVD-1689M数据集上进行训练,分块大小为16,嵌入维度为768,共86M参数,具有强大的泛化能力和语义理解能力。为了保持预训练知识,避免过拟合同时降低训练成本,我们冻结主干网络的所有参数。

为了兼顾全局语义和多尺度定位能力,我们从主干网络的第3、6、9、12层提取多尺度特征,分别对应不同的语义抽象层次。第三层表示低层纹理和边缘信息,第六层表示中层局部模式、第九层表示高层语义结构、第十二层代表全局语义理解。多层特征的引入使模型技能获得深层全局语义一致性,也能保留浅层空间定位信息,为后续金字塔解码提供基础。

在解码过程中,我们将多尺度特征输入UperNet解码器进行融合与上采样。其中UperNet包含两个核心模块:金字塔池化模块(PPM)对最深层特征进行多尺度池化,捕获全局上下文关系,得到增强特征

图像篡改操作通常会引入JPEG压缩伪影、重采样痕迹等频域异常。仅依赖语义分割容易在强压缩、篡改区域小的场景下出现边缘和模糊和细节缺失。为此我们构建频域分支,以补充 ViT 分块化对高频痕迹的削弱。我们引入局部DCT分析,针对双重JPEG压缩、重采样伪影和块效应不一致这类篡改痕迹进行加强。

对输入图像进行局部离散余弦变化的计算方式如下:

(1)与JPEG压缩一致,我们将图片划分为8*8的非重叠块

(2)我们对每个块执行2D DCT,得到64个频域系数

(3)最后提取低频、中频、高频分量作为特征表示

频域特征虽然能检测底层伪影,但容易收到背景噪声干扰,且缺乏对篡改区域的空间定位能力。于是我们引入空间-语义门控模块,利用DINOv3的高层语义特征对频域特征进行调制。如公式【】

$$

Fgate = σ(Ws · Fsem + Wf · Fdct) ⊙ Fdct

$$

其中

门控机制能够在语义显著区域(e.g. 前景物体、拼接边界)增强频域伪影相应,同时在背景区域抑制噪声和无关频域的变化,实现语义引导的频域分析。最终这将生成精细化的频域门控特征$$Mfine$$

最终的预测通过可学习加权融合粗粒度语义掩码和精细化频域掩码,如公式【】 $$ Mfinal = α · Mcoarse + (1 - α) · Mfine $$ 其中$$Mcoarse$$是来自UperNet的粗粒度语义定位,$$Mfine$$是来自门控模块的精细化频域定位,$$α$$ 在0到1之间,是可学习的融合权重,初始化为0.5。

本次实验主要使用了CASIA数据集【CASIA】。该数据集主要包含复制移动和拼接篡改图像,并且有CASIAv1和CASIAv2两个版本。其中CASIAv2包含5123张篡改图像,图像分辨率从240*600到800*600不等,文件格式主要是JPEG,TIFF,BMP,其篡改图像经过后处理,看起来更加逼真。CASIAv1包含920张篡改图像,图像分辨率统一为384*256,文件格式主要是JPEG,其篡改区域没有经过后处理,存在肉眼可见的异常痕迹。我们使用CASIAv2中的篡改图像进行训练,使用CASIAv1中的篡改图像进行测试。【A possible pitfall in the experimental analysis of tampering detection algorithms】指出该数据集中图像使用了若干不同的质量因子进行JPEG压缩,所以应充分考虑JPEG压缩因素对性能的影响。

此外,在跨数据集能力测试中,我们使用了Columbia【】和IMD2020【】数据集。Columbia包含180个篡改样本,主要格式为TIFF,且无后处理,图像大小通常为1152*768或757*568。Columbia数据集主要是为了评估模型在高质量图像及单一拼接方式下的表现。IMD2020包含2010张从互联网上真实收集的篡改图像,主要格式为JPEG,这些图像涵盖了复杂的符合篡改手段,并经历了后处理,主要用于测试模型在复杂干扰下的泛化定位能力

在训练时,我们将所有数据集统一缩放到448*448大小。本文的实验环境为:Python=3.12.3 、Pytoch=2.8.0、Torchvision=0.23.0,使用的显卡是Nvidia GTX5090,使用的优化器为AdamW、学习率为5.0e-5、共训练100个周期、批次大小为16。

本文采用像素级曲线下面积(AUC)和F1分数对模型进行评估。

受试者工作特征曲线(ROC)通常被用于展示分类模型的性能。ROC曲线分别以假阳率和真阳率作为横轴和纵轴,综合反映两者关系。AUC即ROC曲线下面积,值越大分类性能越好。但实际上AUC所反映出来的差距有时不如F1分数明显。

F1分数的计算方式如公式【1】所示: $$ F1 = \frac{2 \times TP}{2 \times TP + FN + FP} $$ 其中TP表示模型预测正确的篡改像素点数目,FP表示模型预测错误的篡改像素点数目,FN表示模型预测错误的载体像素点数目。

此外,F1分数也可以认为是查准率(Precision)和查全率(Recall)的调和平均。由于F1分数综合考虑了查准率和查全率,因此与精度相比能更好衡量篡改定位模型的性能。注意在实际图像篡改定位中,我们无法确定最优阈值,所以在计算平均F1分数的时候我们使用固定阈值0.5。

从表【1】可以看出,在CAISAv2训练后,我们的模型在CASIAv1上有着不错的AUC和F1分数,并且都超过了相同训练策略的【】【】【】。这些其他算法的数据均由各文献报道的实验数据整理而得。

我们将此模型在Columbia和IMD2020数据集中进行训练和测试,比例为8 : 2。同时我们把在CASIAv2训练得到的模型不经过微调,直接用于预测。得到的结果参考表2

从表2中我们可以看出我们在另外两个数据集上也达到了不错的水准。这进一步验证了 DINOv3 强大的特征表征能力与 两阶段 掩码细化策略在处理跨场景篡改检测时的鲁棒性,证明了模型能精准捕获不同成像设备下的边缘异常。其中在CASIAv2训练后我们直接迁移,发现得到效果并不好,可能因为不同数据集后处理方式显著不同。并且我们使用的DCT-Ⅱ模块完全针对于此次以CASIAv1为测试集的任务,可能在其他数据集上开启纹理分支等效果会更好。

我们引入SRM分支后,发现提升并不显著。而后续我们引入DCT Ⅱ模块或者将Sobel算子时,F1分数实现了飞跃。一部分源于CASIAv1的数据集的JPEG压缩特性,另一部分原因在于此任务中,SRM提取的残差对图像本身的纹理过于敏感,这导致了模型训练过程中及其不稳定,并且在强压缩低分辨率的CASIAv1上容易产生背景伪影。

在 F1 分数上,Gate 机制相比 CBP 进一步提升了约 2.45%,训练时间缩短33%,同时 AUC 相差不多。这在一定程度上说明使用使用软门控的方法要优于紧凑双线性池

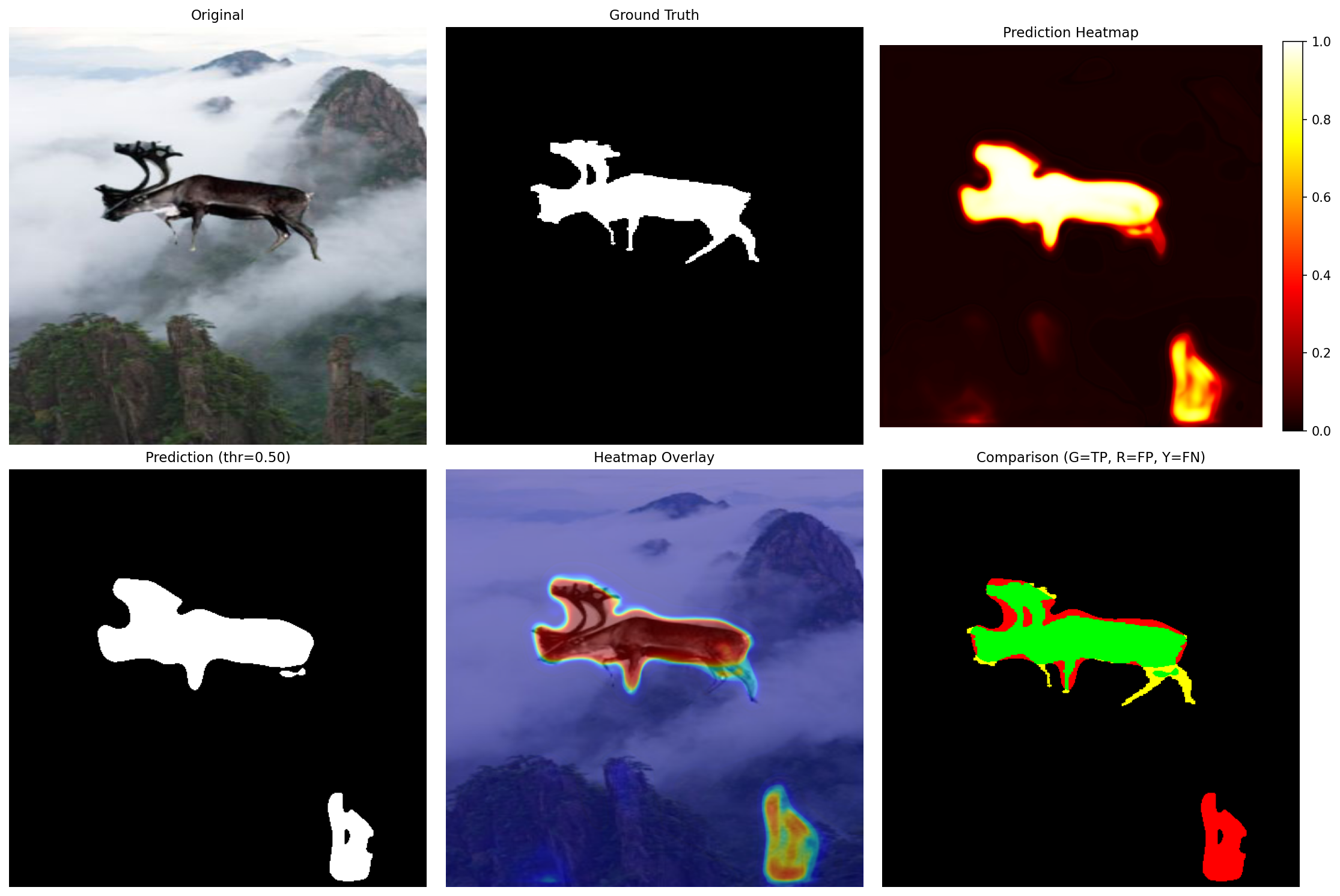

图2为我们使用base+SRM得到的结果。可以发现由于ViT的分块策略,高频信息损失导致边缘模糊,预测得到的掩码边缘圆滑。且印证了上一节讨论到的SRM不稳定易产生伪影,SRM常常将图像中的强纹理区域误判为篡改区域,导致F1分数提升不高。

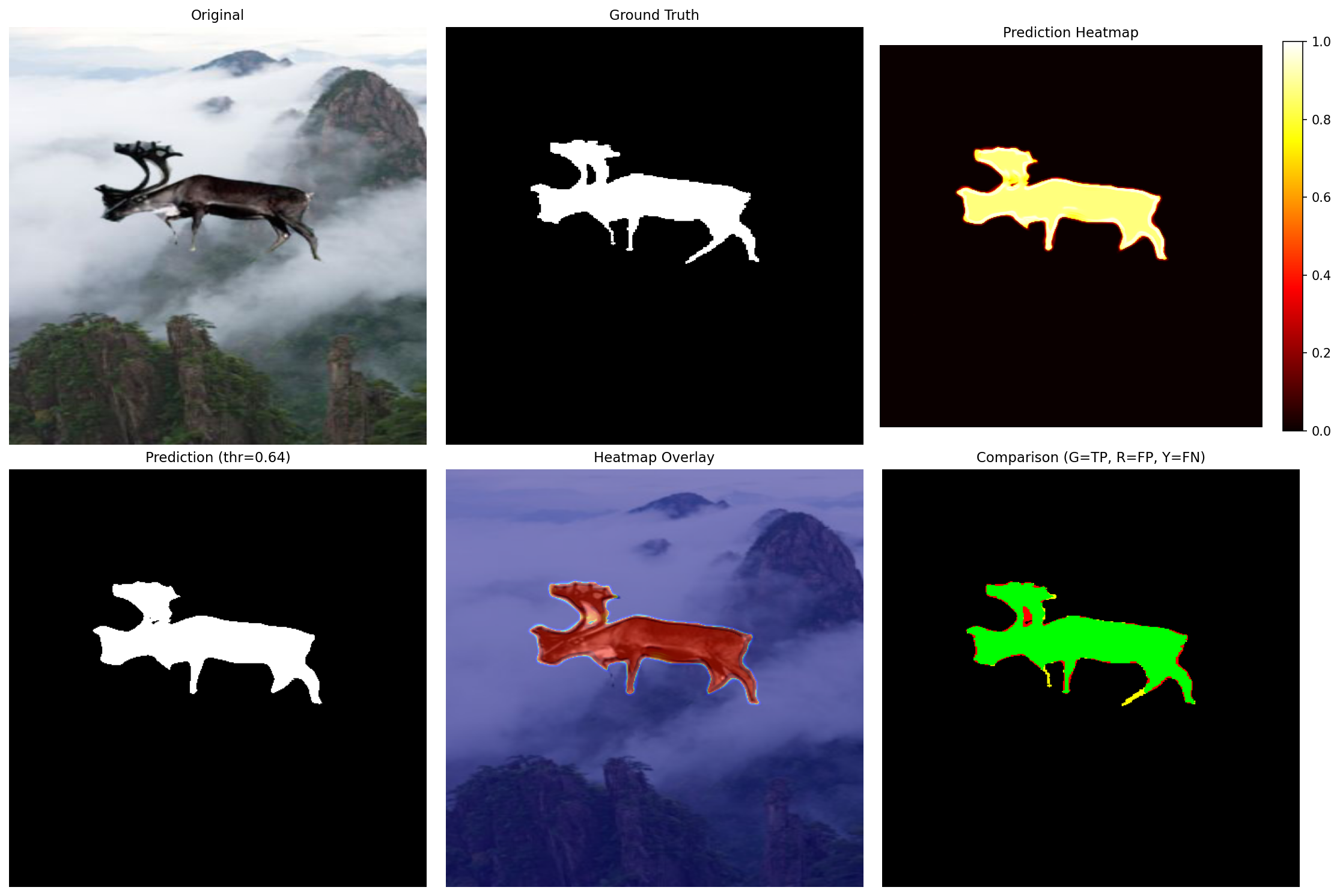

图3为我们使用Sobel优化边缘得到的结果。Sobel优于SRM,主要是因为Sobel提取到的边缘特征在下采样过程中更鲁棒,形状变化更小。而SRM的微观噪声在经过几层卷积和池化后,往往会变成噪声,反而干扰我们的训练。图中可以发现,我们预测的掩码已经能够大致匹配上,但细小区域(e.g. 鹿角之间的空隙)被误判,并且生成的掩码仍然存在模糊现象。同时,Sobel边缘特征太强在一定程度上导致了内部空洞、细长物体断裂等情况(e.g. 花瓣上的纹理出现伪影,长细勺柄中央断裂)

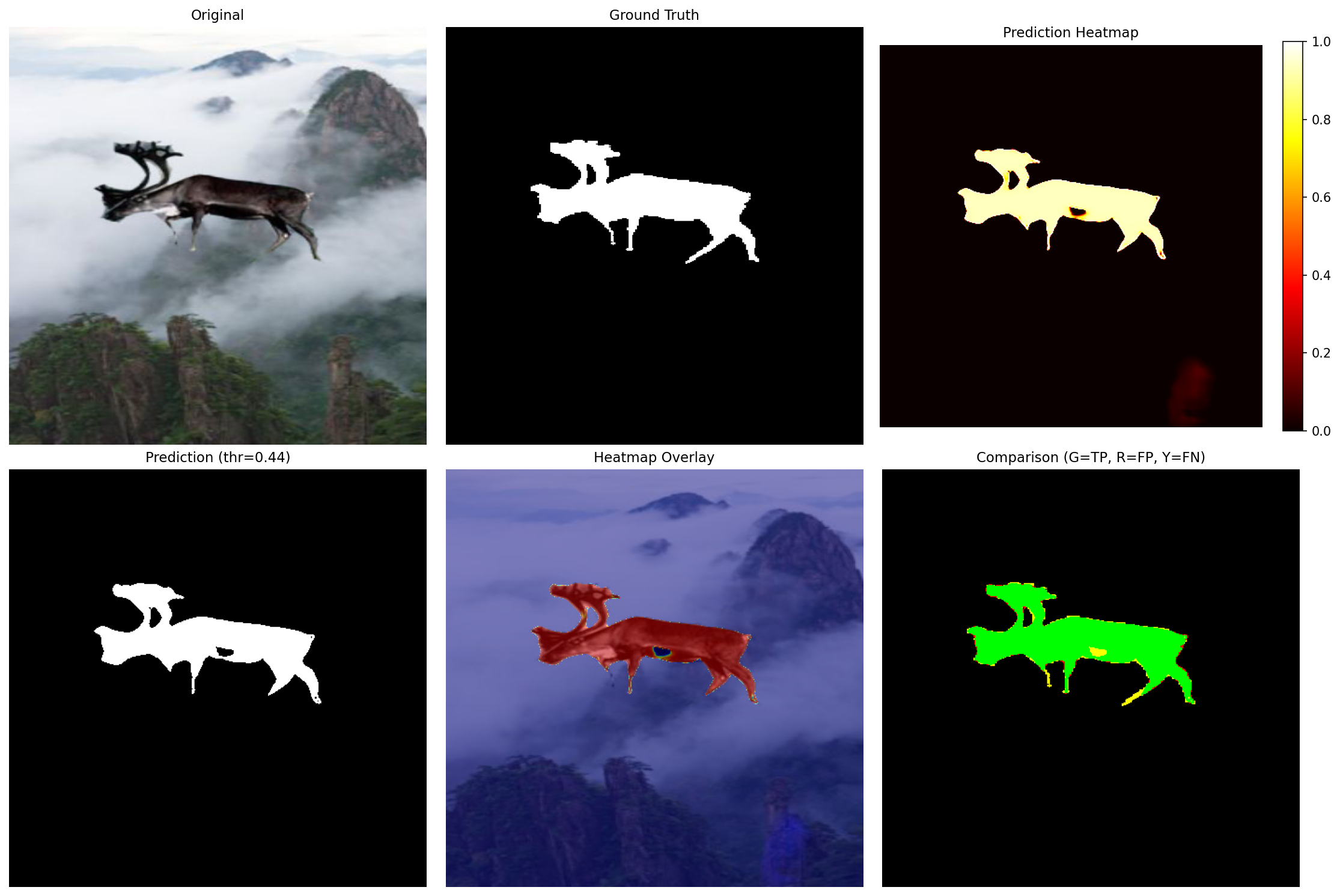

图4为我们的最终方案。我们加入了UperNet,并使用DCT提取频域特征。尽管主流通常采用Sobel算子用于边缘提取,但CASIAv1的图像压缩高且分辨率低,所以Sobel比起DCT在边缘提取上并不占据明显优势,反而DCT对于JPEG压缩更敏感,对于篡改边界的识别更有效。收益于UperNet的跳跃连接,我们将深层语义提取的粗掩码与浅层DCT提供的物理边界进行多尺度融合,最终生成的掩码边缘不再圆润模糊,与Ground Truth高度匹配。

图5为我们使用最终版本在CASIAv1数据集上得到的可视化结果。

本文设计并实现了一个结合全局语义视野与底层物理痕迹的图像篡改定位模型。实验研究发现,传统的 SRM 等噪声提取算子对强纹理背景过于敏感且在低分辨率场景下稳定性较差,而本文提出的基于 DCT-II 的频域分析模块能更精准地捕获 JPEG 压缩相关的统计特征。同时,消融实验结果表明,相比于计算开销巨大的双线性池化,空间-语义门控机制在显著降低计算延迟(缩短约 33% 训练时间)的同时,提供了更优的模态融合效果。虽然理论上纹理分支有助于增强细节,但在实际应用中由于噪声分布不均易导致训练崩溃。本模型最终采用两阶段协同约束策略,利用 UperNet 的跳跃连接将浅层物理边界注入深层语义掩码,实现了像素级的高精度定位。未来的研究将致力于探索如何进一步增强模型对非 JPEG 压缩格式及生成式篡改(AI 生成)的泛化检测能力。

本实验的频域模块仅针对主要任务,对CASIAv1数据集进行优化,而在其他数据集中表现不如目前较新的工作。本文仅考虑了SRM、BayerConv等模块在主要任务中并未起到明显效果,而这些这些模块是否能增强模型的跨数据集通用性,以及后处理的鲁棒性,本文并未涉及。

我们统计了三种算法:支持向量机(SVM),随机森林(RF)和K近邻(KNN)三种方法;rgb、freq、texture、noise四类特征,统计不同算法在不同特征组合下的像素级分类效果。结果如表4。

针对于rgb特征,我们统计颜色直方图(48维,RGB每个通道16维)用于检测颜色分布异常,灰度共生矩阵(20维,包含0°, 45°, 90°, 135°四个方向,对比度、相异性、同质性、能量、相关性五个属性)用于检测纹理一致。通过rgb特征,我们主要捕获到得是语义信息。

针对频域特征,我们计算DCT系数统计(11维,其中全局包含均值、方差等等共五维,低频三维,高频三维)用于检测细节和边缘异常,使用三级小波分解(45维)获得低频和高频子带,分别用于检测平滑区域异常和边缘纹理异常,以及FFT频谱特征(10维,其中全局五维,径向五维)用于检测重采样伪影。

针对纹理特征,我们使用局部二值模式LBP(60维,radius分别为1、2、3,领域分别为8、16、24)提取的归一化直方图作为特征,用于检测纹理拼接痕迹,并且使用Gabor滤波器(36维,四个方向,每个方向得到三维特征)检测方向性纹理异常。

针对噪声特征,我们使用SRM滤波器(15维,有三种SRM核,每种得到五维残差统计)检测隐写和篡改引入的微小噪声,通过高通滤波器(7维,其中Laplacian算子得到3维,Sobel算子得到4维)检测边缘异常,同时计算噪声方差估计检测不同区域噪声水平不一致。

实验结果如下表,我们得到以下结论。(1)从数据上看,频域特征贡献度最高,KNN(Freq)的AUC达到了0.7696,而单RGB仅为0.3441,单Texture仅为0.3191,进一步证实了CASIAv1的JPEG压缩特性,为我们频域分支的涉及提供了思路。(2)融合RGB和Texture后,模型分类效果比起单Freq通常并没有变好,这也印证了我在上述模型的设计。在上述深度学习架构中,我只引用了DCT-Ⅱ模块用于频域分析,并且加入纹理特征后模型反而倒退。这说明Texture特征本数据集中在一定程度上引入了噪声干扰了学习。(3)观察rgb+freq 与 rgb+freq+noise的对比,我们发现模型性能得到了一定程度的提升,比如KNN的AUC提高了3.1%。这说明noise分支可能与其他特征具有良好的互补性。(4)统计下来,SVM的表现最稳定,大多数特征组合下,SVM的AUC保持在0.5-0.77之间。随机森林在高维表现更好,在所有特征情况下,RF的AUC和F1均高于其他两个模型,因为RF具有天然的特征选择能力,能自动抑制无用的颜色或纹理特征。